集成视触觉传感的鳍线型机器人夹爪

本期我们将分享一篇会议论文-gelsightinationferencencencensoftrotics(robotics)-gelslsightfinfinfinfinfinfinfiningingentingons。论文研究团队介绍了一种新型的gelsighting线设计,它不仅可以被动地适应捕获的任何物体,还可以进行高分辨率的触觉重建物体方向的估计、剪切力和扭力的标记跟踪,从而帮助软件机器人执行更多的感知任务。

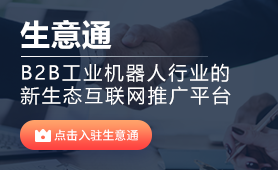

图a为Gelsight鳍线夹持器抓取玻璃瓶;图b为触觉图像;图c为视觉重建,可以看到瓶身上的字母。

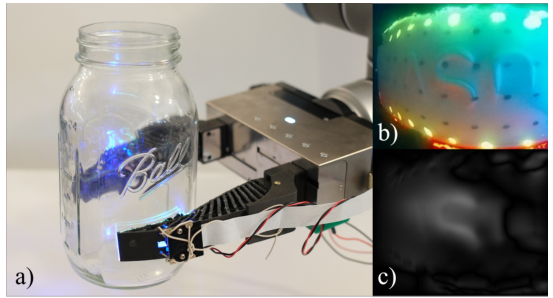

1夹持设计。

传感器设计主要包括三个部分:夹紧设计、触觉传感器制造和照明系统。下图为夹持器制造工艺。

夹紧设计:根据elgeneidy等人提出的设计进行改进,保留鳍线的结构特征,中间部分挖空。夹紧装置中间的材料用硬TPU材料3D打印,后端用硬玛瑙马克锻造。与此同时,内部完全阻挡了光线,黑布阻挡了外部环境的照明,防止了摄像的干扰。同时,为了使夹紧装置灵活,激光切割的黑色弹性布(氨纶/尼龙)在将三个3D打印部弹性布(氨纶/尼龙)粘在柱子和手指开口的下部。然后,用氰基丙烯酸酯胶将手指的两半粘在刚性底座上。

2.收集和处理触觉数据。

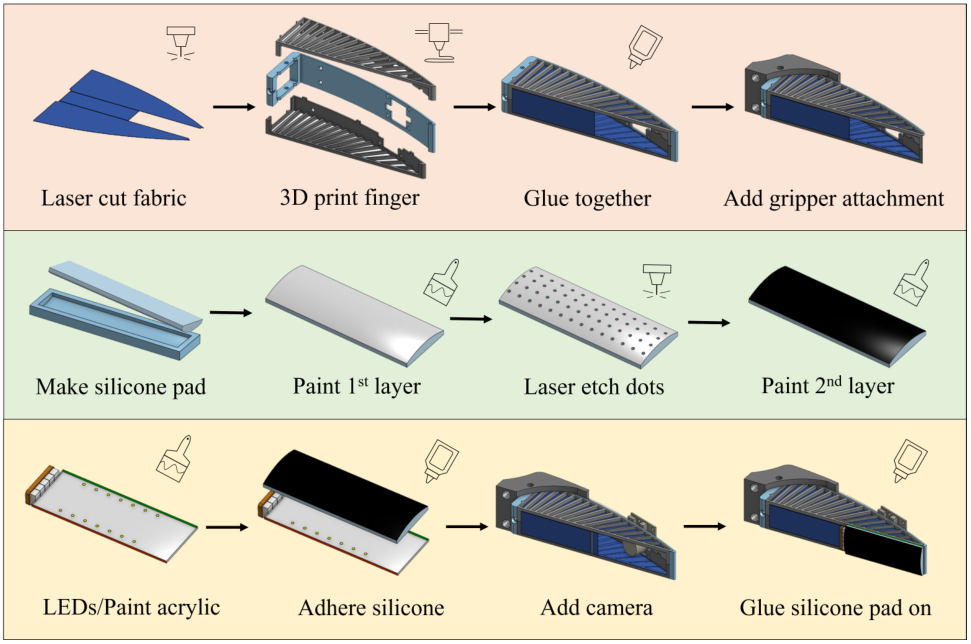

所有触觉视频均采用树莓派fov160°广角相机拍摄。视频通过HSV颜色分割阈值,打开和关闭阈值图像,从参考视频的每一帧中提取一个点中心,并将其转换为numpy阵列。然后用点分割法将后续触摸图像与参考图像进行比较,找到与当前图像最匹配的图像。具体流程如下图所示:

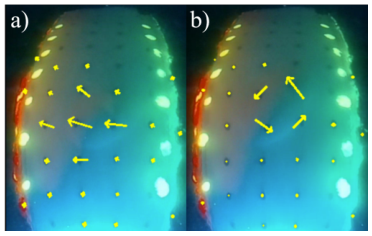

将触摸图像与参考图像匹配后,拍摄不同的图像,然后使用泊松重建计算深度重建图像,在深度图像的阈值上使用轮廓搜索算法,并使用主要成分分析来找到被捕获对象的方向。对于标记点,可以从每个图像中划分并跟踪标记和跟踪LAB色彩空间的亮度通道值模糊图像之间的差值。然后从参考图像标记到最近的实际图像标记绘制箭头。如果两者之间的距离明显,箭头的长度会缩放三次,以强调接触对象的剪切和扭曲。

3相关实验

实验由Python和ROS组合软件驱动相机和UR5机械臂控制,不同的测试对象进行柔性和夹紧测试,测试对象如下:

(以酒杯测试为例,根据触觉传感器的测量方向,然后旋转夹紧器使酒杯垂直。之后,夹紧器将放下酒杯,直到标记跟踪算法检测到的总大小或剪切力超过阈值,表明酒杯与桌子接触。

捕获结果表明,夹具可以捕获所有测试对象,包括不同的大小和形状;对于弯曲的物体,鳍射线手指可以绕过被捕获物体的曲率。对于线性物体,如螺丝刀和立方体,但一旦夹具施加的力增加,夹具将变得更强。

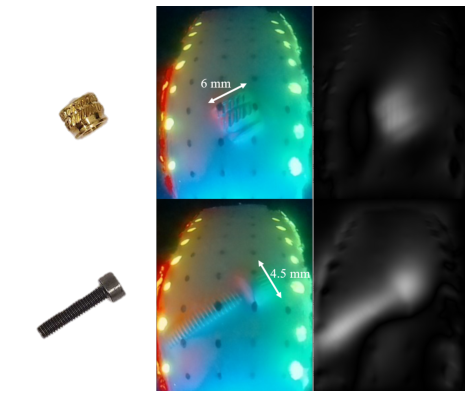

触觉传感器重建的实验结果表明,夹具也可以检测到小细节,如螺钉(如上图所示),这对重建力和滑动也有很好的效果。夹持圆柱体时,下左图(a)表示圆柱体外力的剪切力,下右图(b)表示圆柱体上施加的扭转外力。虽然系统中存在一些噪声,但软件和重建算法相对稳定。

本文介绍了一种新型的灵活性。细长的gelsight传感器可以与鳍线激发的手指结合使用,使其能够执行重建、对象方向估计和标记跟踪。可能存在问题。鳍线夹持器由于材料的生产,需要相当大的力来适应重量大或更弯曲的物体。未来的其他方向包括在三个手指的抓地力上安装gelsight鳍线。抓地力可以利用鳍线的柔软抓地力特性和触觉传感能力来选择和去除成熟的水果而不伤害它们,或者在洗碗机中操作更多的盘子来开发家庭助理机器人。

好的文章,需要您的鼓励

20

- 最新资讯

- 最新问答

-

2025两会热议:工业机器人“黄金五年”已来?

关键字: 工业机器人 2025-03-12 -

AI赋能工业机器人,制造业革命,已悄然来临!

关键字: 工业机器人 2025-01-16 -

巅峰对决完美收官!2024年中关村仿生机器人大赛各项冠军出炉!

关键字: 仿生机器人 2024-11-29 -

出海+ | 极智嘉10月全球新动态

关键字: 极智嘉 2024-10-24 -

会议邀请 | 昇视唯盛邀请您参加第8届国际机器人焊接、智能化与自动化会议暨第15届中国机器人焊接会议

关键字: 昇视唯盛 机器人焊接 会议 2024-10-17

-

智能焊接机器人的优势有哪些?

标签: 焊接机器人,工业机器人,配天机器人 提问:小王 2025-06-04 14:03:04 -

自动装卸货机器人的组成部分有哪些?

标签: 赛那德机器人,装卸货机器人,赛那德 提问:李子 2025-05-28 11:03:03 -

激光焊接机器人的特点有哪些?

标签: 激光焊接机器人,焊接机器人,工业机器人 提问:小T 2025-04-15 11:02:00 -

工业机器人码垛原理是什么?

标签: 码垛机器人,工业机器人 提问:晓明 2025-03-24 12:00:00 -

什么是自动焊接和半自动焊接?

标签: 焊接,焊接机器人 提问:小君 2025-03-18 09:00:00

- 2022-05-25 19:51:49

- 2016-07-21 07:20:51

- 2019-02-13 15:41:47

- 2020-12-22 09:59:12

- 2018-03-27 13:25:55

- 2022-02-23 10:43:46

- 2018-09-12 14:35:07

- 2018-09-11 11:35:11

- 2025-03-12

- 2025-01-16

- 2024-11-29

- 2024-10-24

- 2024-10-17

- 2024-10-16

- 2024-10-16

- 2024-10-16

- 2024-10-15

- 2024-10-15