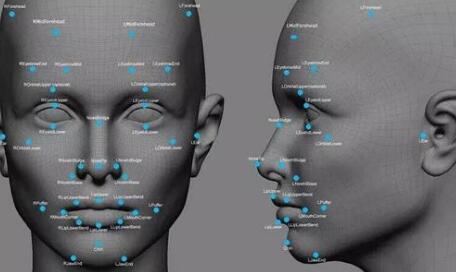

面部识别中的有害偏见,阻碍了深度检测

南加州大学的研究人员在Deepfake数据集和检测模型中存在偏见。一个普遍使用的数据集“绝大多数”是白人,尤其是白人女性。Deepfake检测器无法发现有色人种的欺诈性图像和视频。

行业中的许多人认为Deepfake算法的发展是如此迅速,以至于如此之快,以至于自动检测器将很快成为发现它们的唯一希望。

一个由研究员有三个为根据性别和种族中的误码率10.7%,差异知名deepfake探测器,发现尽可能多的尝试。

他们俩发现,尤其是流行的FaceForensics ++的平衡性很差。重要的是要注意对AI数据集中的偏见的关注是非常新的。随着改进,一段时间以来会出现更多的代表性不足的例子。

研究人员写道,在尝试发现假冒视频时,实现较低的假阳性率是一个“具有挑战性的问题”。

他们使用FaceForensics ++和Blended Image生物特征数据集,训练了MesoInception4,Xception和Face X射线模型,所有这些模型在视频检测中都“被证明是成功的”。这三个代表各种规模、架构和损失表述。

这三个检测器在男性和女性面部上的表现均相同,错误率的差异为0.1%至0.3%。用混合图像训练的检测器在显示较暗的非洲图像时效果最差,错误率相差3.5%至6.7%。

“混合图像”和“面部X射线”在处理白人男性面孔方面最为成功,所有白人面孔的错误率均为9.8%,白人男性的错误率为9.5%。

VentureBeat中的一篇文章对USC论文与去年科罗拉多大学博尔德分校,发表的另一篇论文进行了比较。根据该出版物,微软、Clarifai、亚马逊和其他公司编写的算法至少有95%的时间正确地识别了男性。

但是跨性别者中有38%的人将男性误认为女性。

一些研究人员正在研究面部生物特征活动性检测。一种努力认识到当血液在皮肤下以脉冲形式冲洗时,人的脸部会发生快速而细微的颜色变化。

Facebook仍因无法将危险的政治宣传与有关医疗保健的知情人士分开而烧伤,它在去年6月结束的Deepfake Detection Challenge中提供了100万美元的奖金。

好的文章,需要您的鼓励

11

- 最新资讯

- 最新问答

-

极致清晰!海康机器人发布2.45亿像素XoFLink光口相机

关键字: 海康机器人 2024-12-05 -

MiR 发布 MC600 移动协作机器人, 以高负载精密协作技术重塑工业生产模式

关键字: 名傲移动机器人 2024-12-03 -

“机器人关节”被TA硬控了

关键字: 美的工业 rv减速机 2024-10-16 -

新品解读 | 行业颠覆性JAKA MAX系列,首发负载40kg

关键字: 节卡 协作机器人 新品 2024-10-11 -

兼顾极小码与大景深,超耐用手持读码器IDH9000全新上市

关键字: 海康 读码器 新品 2024-09-19

-

智能焊接机器人的优势有哪些?

标签: 焊接机器人,工业机器人,配天机器人 提问:小王 2025-06-04 14:03:04 -

自动装卸货机器人的组成部分有哪些?

标签: 赛那德机器人,装卸货机器人,赛那德 提问:李子 2025-05-28 11:03:03 -

激光焊接机器人的特点有哪些?

标签: 激光焊接机器人,焊接机器人,工业机器人 提问:小T 2025-04-15 11:02:00 -

工业机器人码垛原理是什么?

标签: 码垛机器人,工业机器人 提问:晓明 2025-03-24 12:00:00 -

什么是自动焊接和半自动焊接?

标签: 焊接,焊接机器人 提问:小君 2025-03-18 09:00:00

- 2015-03-20 00:00:00

- 2018-09-14 10:07:09

- 2023-03-31 17:43:38

- 2020-03-25 13:20:49

- 2020-03-10 16:21:41

- 2017-11-29 00:00:00

- 2022-08-10 09:18:03

- 2022-12-06 09:21:05

- 2022-12-06 16:18:04

- 2018-12-26 08:15:34

- 2022-12-27 14:28:44

- 2022-09-08 12:15:03

- 2024-12-05

- 2024-12-03

- 2024-10-16

- 2024-10-11

- 2024-09-19

- 2024-09-13

- 2024-09-12

- 2024-09-05

- 2024-09-05

- 2024-09-04